鱼明珉来自奥菲寺。

量子报道|微信官方账号QbitAI

看这蓬松的头发和帅气的动作。你以为是绿屏前的大片?

不不不

其实这是AI拍视频实时抠图后的效果。

没想到,实时视频抠图现在可以细致到每一根头发。

切换到阿尔法通道,再看一眼。Dove赚钱就不用说了(手动狗头)。

这是来自字节跳动实习哥哥的最新研究:实时高分辨率视频抠图方法。

不需要任何辅助输入,把视频扔给这个叫RVM的AI,它就能分分钟帮你高精度挑出人像,把背景换成可以随意处理的绿屏。

不信这么丝滑?我们亲自尝试了一波在线演示。

相比之下,现在的在线会议软件中,一旦头发遮住了脸,人就消失了…

头发明显烧焦了。

难怪网友直言:

我无法想象你是怎么把这个AI装进手机的。

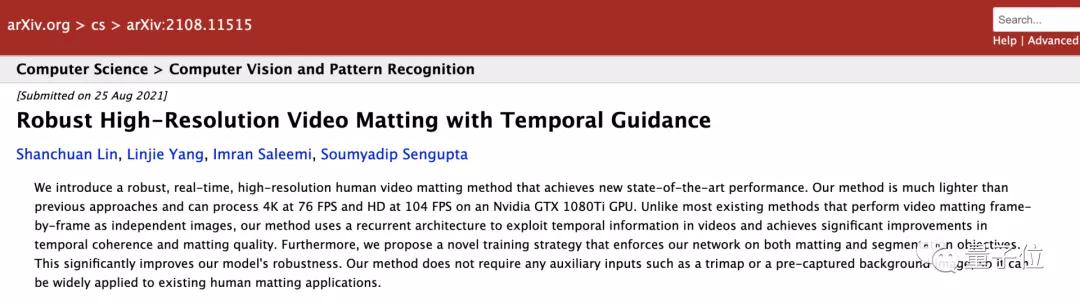

目前,该论文已入选WACV 2022。

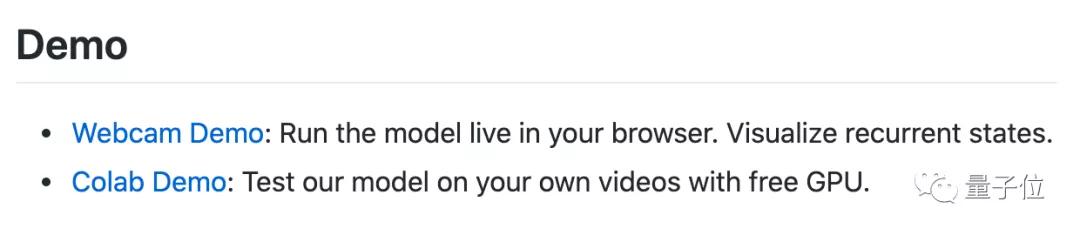

目前RVM已经在GitHub上开源,给出了两种试用方式:

于是我们赶紧试了一下。

先来看看效果:

让我们从不太难的开始。

在画面中人物基本不动的情况下,RVM可以说表现得非常好,和人工抠图差不多。

现在,王冰冰在不违背自己意愿的情况下进入了动态森林。

所以开个脑洞容易多了...

好了,言归正传。如果人物的行动范围加大会怎么样?

对于多人舞蹈视频,RVM也很好看。

即使你四处走动,乱丢头发,也不影响它的抠图效果。

只有人物被屏蔽了,才会有瑕疵。

相比前辈方法MODNet,真的有不小的提升。

然而,我们也发现,如果视频的背景是黑暗的,它会影响RVM。

比如背景光暗的时候,抠图的效果就很不理想。

大家可以看到,博主哥哥的头发完全烧焦了。

而且身体的边界线也不够清晰。

所以想自己做视频演示,一定要选择光线充足的场景。

利用时间信息这种“神奇”实际上是如何实现的?

老规矩,先看看论文吧~

其实现在视频抠图算法并不少见,大部分都是把视频中的每一帧作为一个独立的图像来抠图的方法。

相反,在本文中,研究人员构建了一个循环架构,利用了视频的时间信息,在时间一致性和抠图质量上有了显著的改善。

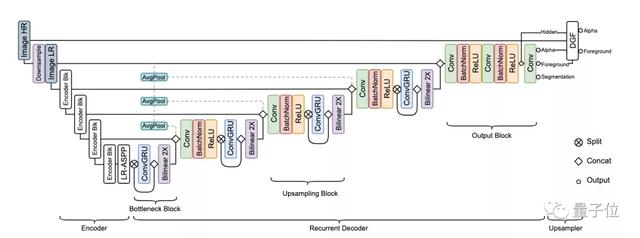

从上图可以看出,RVM的网络架构包括三个部分:

用于提取单帧特征的特征提取编码器;

用于汇总时间信息的循环解码器;

用于高分辨率上采样的深度导向滤波(DGF)模块。

其中,循环机制的引入使得AI能够在连续的视频流中进行自我学习,从而知道哪些信息需要保留,哪些信息可以遗忘。

具体来说,循环解码器使用多尺度ConvGRU来聚合时间信息。其定义如下:

在这个编码器-解码器网络中,AI将完成高分辨率视频的下采样,然后使用DGF对结果进行上采样。

此外,研究人员还提出了一种新的训练策略:使用目标数据集的抠图和语义分割来训练网络。

这具有以下优点:

首先,人像抠图与人像分割的任务密切相关。人工智能必须学会从语义上理解场景,以便鲁棒地定位人物的主题。

其次,现有的抠图数据集大多只提供真实的alpha通道和前景信息,因此必须合成背景图像。但前景和背景的光照往往不一样,影响合成效果。语义分割数据集的引入可以有效防止过拟合。

最后,语义切分数据集具有更丰富的训练数据。

经过这次训练,RVM和它的前辈相比有什么进步?

从效果对比中,可以明显感受到:

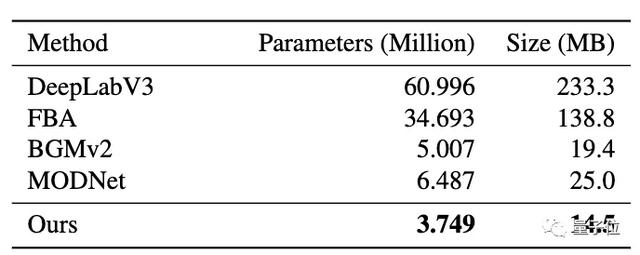

另外,与MODNet相比,RVM更轻更快。

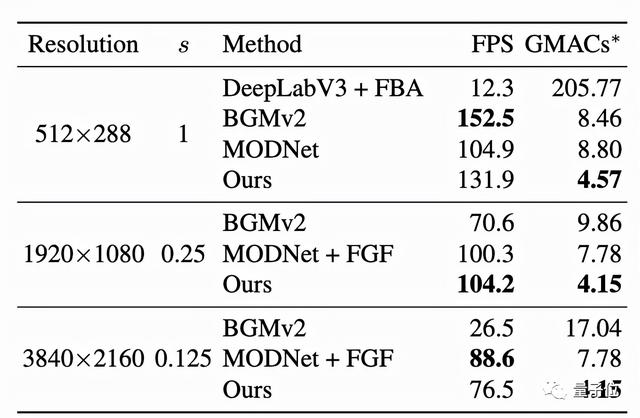

从下表可以看出,RVM的处理速度在1080p视频上最快,在512×288上略慢于BGMv2,在4K视频上慢于带FGF的MODNet。研究人员分析说,这是因为除了阿尔法通道,RVM还预测了未来。

更直观的数据是,在英伟达GTX 1080Ti上,RVM可以处理76FPS的4K视频和104FPS的高清视频。

一作字节跳动实习生本文由a 林山川在字节跳动实习期间完成。

他毕业于华盛顿大学,获得学士和硕士学位,曾在Adobe、脸书等大厂实习。

2021年3月至6月,林山川在字节跳动实习。8月份刚加入微软。

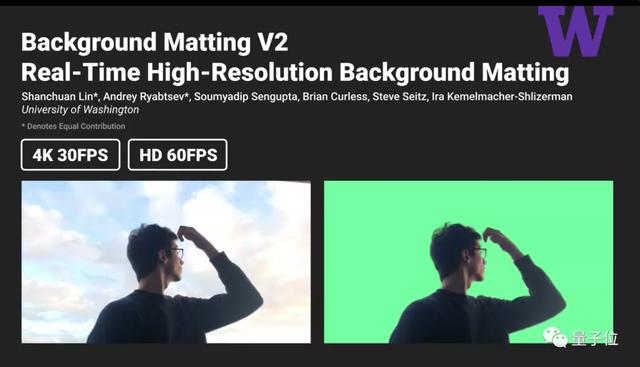

事实上,林山川之前就凭借艾图图大法获得了CVPR 2021最佳学生论文荣誉奖。

他以作者身份发表了论文《实时高分辨率背景抠图》,并提出了背景抠图V2方法。

该方法可以处理30FPS的4K视频和60FPS的高清视频。

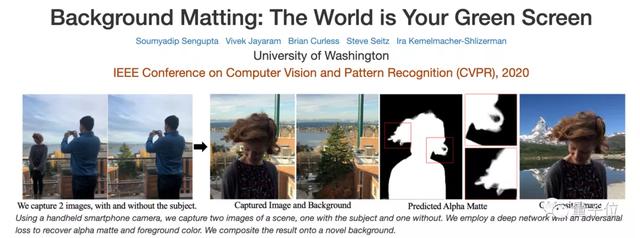

值得一提的是,这一系列背景抠图的方法不止一次赢得了CVPR。此前,第一代背景抠图包含在《CVPR 2020》中。

两篇论文的通讯作者是华盛顿大学副教授Ira Kemelmacher-Shlizerman,他的研究方向是计算机视觉、计算机图形学、AR/VR等。

此外,本文的第二个工作是的研究科学家杨。我本科毕业于清华大学,并在香港中文大学获得博士学位。

对了,除了可以在Colab上试用,还可以在网页版上实时感受这个AI的效果。记下地址:

https://peterl1n.GitHub.io/RobustVideoMatting/#/demo

GitHub地址:

https://github.com/peterl1n/robustvideomatter

论文地址:

https://arxiv.org/ABS/2108.11515

参考链接:[/br]r/machine learning/comments/pdb pmg/r _ robust _ high resolution _ video _ matting _ with/

结束-

量子QBITAI头条号签约

关注我们,第一时间了解前沿科技动态。