【新智元导读】刚刚,深圳发布会上,华为副董事长、轮值董事长徐直军正式商用发布AI芯片“昇腾 910”,与之配套的新一代AI开源计算框架MindSpore也同时亮相!徐直军表示,昇腾 910是算力最强的 AI 处理器,而且当之无愧!

周一,美国商务部长宣布将华为的“临时许可”延长90天。

而就在刚刚,华为为我们打了一剂强心剂:采用达芬奇架构的又一款AI芯片——昇腾 910 ( Ascend 910) 正式商用,与之配套的Mindspore全场景AI计算框架也震撼发布!

作为华为 “达芬奇项目” 的重磅成果,用华为副董事长、轮值董事长徐直军的话来说,华为昇腾 910 是算力最强的AI处理器。

有多强,请看实际测试结果:

- 半精度 (FP16)算力达到256 Tera-FLOPS

- 整数精度 (INT8) 算力达到512 Tera-OPS

昇腾910首次亮相是在2018年的华为全联接大会上,徐直军首次阐述了华为 AI 战略,并正式公布了昇腾 910 和昇腾 310 两款 AI 芯片。当时,徐直军表示,昇腾 910 是单芯片计算密度最大的芯片。

在那次大会上,徐直军当场拿出昇腾 310展示,最大功耗仅 8W 的极致高效计算低功耗 AI 芯片华为昇腾 310 去年已经商用量产,而华为昇腾 910 就在今天正式商用。

徐直军表示:昇腾910总体技术表现超出预期,作为算力最强AI处理器,当之无愧!

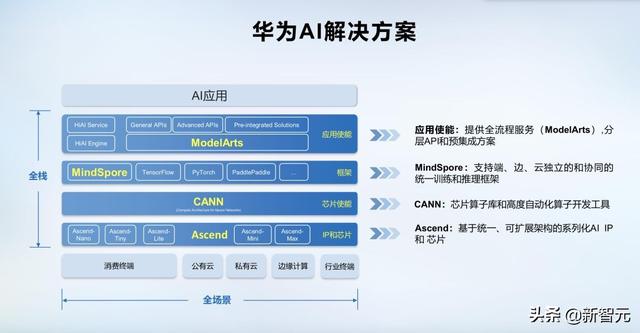

现场,徐直军先介绍了华为AI解决方案,以及基于昇腾310的产品和云服务的广泛应用。

接着,徐直军说:“我宣布,算力最强的AI处理器 Ascend 910 正式推出。去年10月,我们发布了Ascend 910的技术规格,今天我向大家介绍最新的实际测试结果。”

昇腾910属于Ascend-max系列,徐直军公布了其最新测试结果:

- 半精度 (FP16)算力达到256 Tera-FLOPS

- 整数精度 (INT8) 算力达到512 Tera-OPS

- 而且,达到规格算力所需功耗仅310W,明显低于设计规格的350W。

也就是说,在算力方面,昇腾910完全达到了设计规格,下面是昇腾910初次亮相时公布的设计规格:

昇腾910设计规格:

- Ascend-Max

- 架构:达芬奇

- 半精度(FP16):256 TeraFLOPS

- 整数精度(INT8):512 TeraOPS

- 128 通道 全高清 视频解码器 -H.264/265

- 最大功耗:350W

- 7nm

昇腾910 基于 7nm 增强版 EUV 工艺,单 Die 内建 32 颗达芬奇核心,半精度高达 256 TFOPs,最大功耗 350W。

徐直军说,昇腾910总体技术表现超出预期。昇腾910已经被用于实际AI训练任务。其中,在典型的ResNet-50 网络的训练中,昇腾910与MindSpore配合,与现有主流训练单卡配合TensorFlow相比,显示出接近2倍的性能提升。每秒训练的图片数量从965张提升到1802张。

徐直军现场表示:“昇腾910总体技术表现超出预期,作为算力最强AI处理器,当之无愧!”

高算力、高集成度、高速互联,便共同铸造了 业界最强大的 AI 处理器 —— 昇腾 910

基于达芬奇架构的 AI 核是计算核心。除了标量和矢量计算单元,AI 核集成了 3D 立方体计算引擎,能够在一个时钟周期内完成 4096 的乘加运算。

与 CPU 和 GPU 相比,有两个数量级的提升,昇腾 910 集成了 32 个立方体计算引擎,能够输出 256TFLOPS。

它不仅是一颗强大的 AI 计算处理器,而且还是一个高度集成的片上系统,集成了 CPU、DVPP 以及任务管理器。

这些单元给昇腾 910 提供了一种 “自治” 能力,使其可以独立完成整个 AI 的训练流程,最小化与 Host 的交互,从而充分发挥其算力。

创建一个强大的训练系统不仅需要芯片自身强大的算力,高效的通信机制也是必不可少的。

昇腾 910 集成了 HCCS、PCIe 和 RoCE 三种高速接口。

其中,自研的 HCCS 可以提供单接口 240Gbps 的传输。

也正是采用了最新的 PCIe,使得吞吐量比上一代翻倍。

而芯片上集成的 RoCE 接口,则为多节点间提供了高效的数据交互的互联方案,这些互联技术大幅提升了构建训练系统的性能和灵活性。

最后,现场有记者e,昇腾910售价多少呢?毕竟我们知道英伟达的GPU和谷歌的TPU都有定价。

徐直军笑道:“售价具体还没定出来,但肯定不会比他们(英伟达和谷歌TPU)高。”

昇腾310和昇腾910仅仅是一个开始。徐直军表示,未来将持续投资,推出更多的AI处理器,面向边缘计算场景,在已经商用Ascend 310基础上,计划2021年将推出Ascend 320。

上面是昇腾处理器的一系列计划时间表,可以看到,该系列芯片覆盖训练、MDC/DC、边缘计算多种场景,即将在2021年推出用于训练场景的昇腾920,边缘计算场景的昇腾320.

MindSpore 全场景AI计算框架,明年Q1开源!此外,徐直军还发布了全场景AI计算框架 MindSpore,并宣布“MindSpore将在2020年Q1开源”!

徐直军表示:能否大大降低AI应用开发的门槛,能否实现AI将无处不在,能否在任何场景下确保用户隐私得到尊重和保护,这些都与AI计算框架息息相关。

在去年HC会上,华为提出:AI框架应该是开发态友好(例如显着减少训练时间和成本)和运行态高效(例如最少资源和最高能效比),更重要的是,要能适应每个场景包括端、边缘和云。

一年后的今天,全场景AI计算框架MindSpore在这三个方面都取得了显著的进展:在原生适应每个场景包括端,边缘和云,并能够按需协同的基础上,通过实现AI算法即代码,使开发态变得更加友好,显著减少模型开发时间,降低了模型开发门槛。

MindSpore如何做到更快更高效?MindSpore秉承“AI算法即代码”理念,提供一系列的关键技术,例如MindSpore自动微分,采用Source 2 Source方式实现,在性能和可编程性上,明显优于业界图和运算符重载方式。能够实现任意算子的微分表达和编译优化,同时实现反向算子自动生成,极大地方便了模型开发。

而随着数据集和模型规模越来越大,模型并行将成为必然趋势。相比手工切分的模型并行的门槛高、效率低、调优难,MindSpore只需定义单机模型,即可自动实现多机混合并行运行,无需了解AI集群细节。

主从控制模式中,CPU和GPU交互引入内存和数据开销。MindSpore在芯片上完成神经网络模型训练的所有控制和执行,减少和主机CPU的交互时间,速度更快。并在已有的分布式训练方案引入中心控制来寻找梯度同步点,MindSpore实现了去中心化的分布式梯度聚合,完全消除控制开销。

最终,软硬件优化为不同类型算子映射最佳的计算单元和数据布局,获得最佳的性能。

通过MindSpore自身的技术创新及MindSpore与Ascend处理器协同优化,实现了运行态的高效,大大提高了计算性能。除了昇腾处理器,MindSpore也支持GPU、CPU等其它处理器。

现在已有了TensorFlow、PyTorch框架,但还没有任何一个现有框架支持全场景,而这就是华为要做的——覆盖端-边缘-云,做一个能支持全场景的框架,实现AI无所不在越来越基础的需求,这也是MindSpore的重要特色。

针对不同的运行环境,MindSpore框架架构上支持可大可小 ,适应全场景独立部署。同时,MindSpore框架通过协同经过处理后的、不带有隐私信息的梯度、模型信息,而不是数据本身,以此实现在保证用户隐私数据保护的前提下跨场景协同。除了隐私保护,MindSpore还将模型保护Built-in到AI框架中,实现模型的安全可信。

为了降低AI开发者的开发门槛,MindSpore创造性地实现了AI算法即代码,使开发态变得更加友好,显著减少模型开发时间。以一个NLP(自然语言处理)典型网络为例,相比其他框架,用MindSpore可降低核心代码量20%,开发门槛大大降低,效率整体提升50%以上。

华为全栈全场景AI解决方案已经完成最后,徐直军说,去年在HC大会上发布的全栈全场景AI解决方案已经完成了构建!这对华为的AI业务来讲是一个新的里程碑,更是一个新的开始!

昇腾910商用以后,华为云AI将为客户提供充裕经济的算力。通过MindSpore,华为云让科学家更高效地完成AI算子开发(比如自动微分功能),缩短开发周期,减少开发工作量。

同时,MindSpore可以发挥出昇腾芯片最大计算潜能,这样软硬件协同可以更好地利用芯片算力。华为云致力于解决AI应用过程中面临的“贵”和“难”的问题,降低AI计算的门槛,实现普惠AI。新智元将在下周对此进行更深入的阐释。